新着情報

研究チーム『山田CREST』について

JST CREST 研究チーム『納得感のある人間-AI協調意思決定を目指す信頼インタラクションデザインの基盤構築と社会浸透』

JST CREST「信頼されるAIシステムを支える基盤技術」の研究チーム『納得感のある人間-AI協調意思決定を目指す信頼インタラクションデザインの基盤構築と社会7浸透』(研究代表者:山田誠二(国立情報学研究所/総研大),2021年10月~2027年3月 5.5年) の活動を発信するwebサイトです.(2020年度,2021年度採択課題)

人間とAIの『信頼』とは?

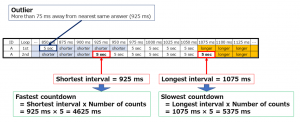

信頼 (trust),信頼較正,不信/過信などの概念を以下のように数理的に定義し,従来のマシンの信頼性 (reliability) とは明確に区別しています.

- 信頼 (trust):人間のAIに対するタスク成功確率の推定値

- 最適信頼 (optimal tsust):信頼の真値

- 過信/不信 (over trust/under trust):信頼の過大/過小推定

- 信頼較正 (trust calibration):人間が自分のAIに対する信頼を修正して信頼を最適信頼と一致させること(=正確なAIの信頼を見積もること)

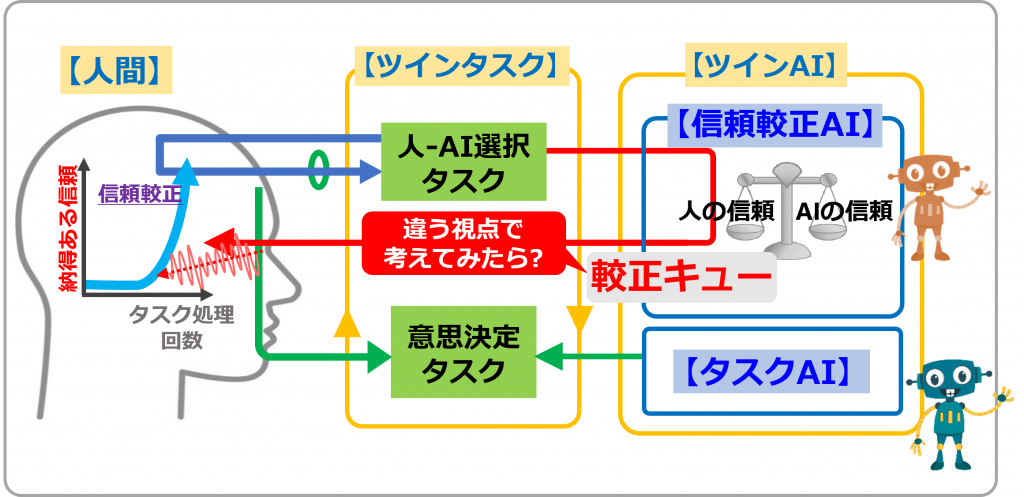

人間-AI間の最適な信頼関係

人間-AI協調意思決定において,信頼較正AIが人間の意思決定をモニターすることで人間がAIに対して過信/不信なのかを判定します.もし過信/不信が検出されると,人間に対してえん曲的に修正を促す刺激(較正キュー)を表出することで,人間が自ら信頼を較正していきます.この適応的信頼較正理論により,人間とAIの最適な信頼関係の構築を目指します.もっと見る

医療分野へ応用

本チームで開発した適応的信頼較正理論を医療分野へ応用します.応用対象となる医療分野は,以下の2つの検診です.

人間-AI協調肺がん検診:胸部X線画像の読影タスクAIを開発し,それらを用いた適応的信念較正理論を実装する.100名以上の医師の協力を得て,人間-AI協調肺がん健診の大規模実験を実施,実稼働する.

5歳児協調検診:肺がん検診よりもさらに複雑な処理を要する5歳児の発達障害検診において,複数タスクAIを開発,それらを用いた適応的信念較正理論の基に協調検診システムを開発する.最後に,それらを大規模実験・実稼働を達成する.

主要メンバー

山田 誠二

研究代表者

国立情報学研究所・教授

日本発のAI研究分野 ヒューマンエージェントインタラクション HAI (human-agent interaction) のパイオニア.元人工知能学会 会長.

『AIのためのUI&UX・インタラクティブAI研究を推進し,AIの社会導入を加速する!』

寺田 和憲

主たる共同研究者

岐阜大学 工学部・教授

認知モデル・HAIで気鋭の研究者.認知バイアス,認知科学,強化学習などが専門.

『人の社会知能,特に概念表象と意思決定について,心理実験,統計解析,シミュレーションを用いて明らかにする』

小野 哲雄

主たる共同研究者

北海道大学 情報科学研究院・教授

ヒューマンロボットインタラクションHRI,環境知能で著名な先駆的研究者.近年は,ナッジの工学応用であるナッジエージェントを提唱.

『認知情報科学の立場から,HAI/HRI/環境知能システムを構築し,人間とは何かを知りたい』

原 武史

主たる共同研究者

岐阜大学 工学部・教授

医療画像(X線写真)を読影する医療AIのエキスパート.医学と工学のブリッジングができる有数の研究者.

『ソフトウェアと人が共存する画像診断環境は,病気の発見と予後予測の精度向上に直結する』